Home Computing的概念涵蓋了未來世界中,在企業以及個人環境中所需要的本地端(Local)的AI運算與儲存系統。而本文最後,群聯電子將分享aiDAPTIV+ 是如何透過技術創新落實此理想。

.

.

Home Computing,本地端應用帶來眾多好處

簡單來說,現代商業環境中的on-premise server 與個人環境所使用的AI PC即是Home computing所涵蓋的使用情景。全球AI技術發展的趨勢,不意外地從雲端環境中落地發展,接下來,企業與個人對於AI的需求也快速興起,隨之而來的是更多的隱私、安全性、個人化,與成本優化的問題,Home computing泛指能夠克服上述所有問題的本地端AI解決方案,這不單是一個容易記住的名詞,其概念凸顯出個人和商業環境中使用私有、本地運算及儲存與雲端所帶來的不同。

相較於將資料上傳至雲端進行運算和儲存,Home computing具有許多明顯的好處:

- 提高資料的安全性和隱私性:使用本地伺服器進行運算和儲存能夠提供更高程度的控制和保護個人或企業的敏感數據,避免遭受外部入侵和資料外洩的風險。

- 較快速和穩定的運算速度:本地運算可以加快運算速度,提高效率,特別是在需要處理大量數據或複雜運算的情況下,明顯優於上傳至雲端運算。

- 更靈活的運算體驗:利用本地伺服器進行運算,用戶可以享受更個性化、定製化的運算體驗,可以根據自身需求進行設置和調整。

- 成本效益:使用本地伺服器進行運算和儲存可能會降低整體成本,因為不需要為外部雲端服務的運算與傳輸支付月費,因此可以更加有效地控制硬體設備和軟體的成本,符合個人或企業的預算需求。

- 網路穩定性:使用本地伺服器進行運算可以避免依賴於網路連接,可以提供更穩定的運算環境。當網路連接出現問題時,本地伺服器仍可以繼續運作,不受網路狀況變化的影響,確保持續的運算穩定性和效率。

- 普及化”聯合學習”的訓練模式: 聯合學習的優勢在於參與者只需要共享AI模型,不需要分享具機密性的資料、數據,即可找出最佳化的人工智慧應用。不僅可解決資料治理及個人隱私保護問題,並可同時達到精進AI模型之目的。

- AI模型訓練民主化: 核心概念在於使用 AI 的層面,已經不僅是「AI 如何提供服務的自由」,而延伸到「所有使用者都能夠擁有符合個人需求 AI 的自由」。實現藉由簡單的訓練,讓更多人能夠真正在工作、生活中受益於AI的願景

然而,要落實Home Computing,使其普及,讓這世代的AI更加速的發展,仍須克服硬體擴充時所造成的高昂代價。我們都知道AI運算,很貴。

資料自主性的重要

「AI基礎建設不能假他人之手。」

.

.

.

AI運算需要大量參數與數據,儲存技術最重要的時刻到來

隨著生成式AI和大型語言模型的能力不斷提升,所需的模型大小及參數數量也爆炸性成長,導致模型訓練過程中,需要大量的記憶體空間和運算能力來處理海量的計算數據。 以目前最為知名的GPT-3模型為例,其參數數量已經來到1750億個之多,若是要執行單次的模型訓練就需要建置多組配備有高階顯示卡及高速記憶體的伺服器來進行運算,然而所需的資本投入和設備花費更是動輒超過千萬台幣,並不是一般小型企業和家庭用戶能夠負擔的金額,這也大幅提高了生成式AI模型落地訓練的進入門檻,並成為Home computing全面發展的最大阻礙。

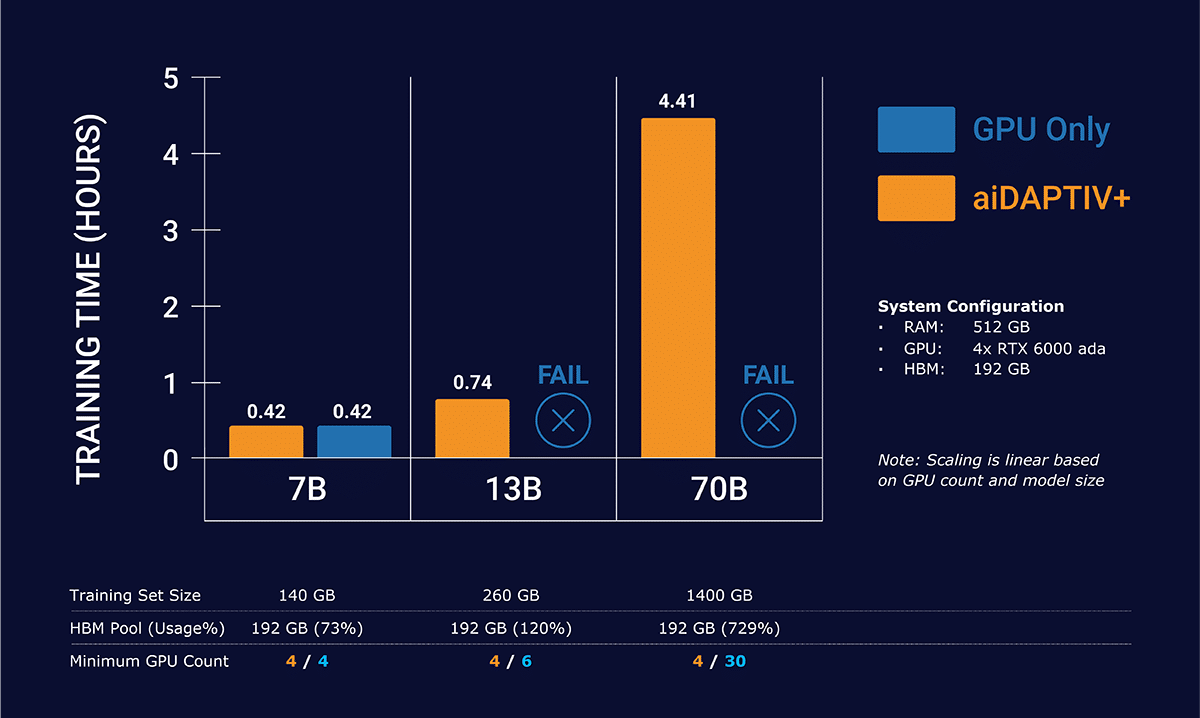

目前顯示卡配備的記憶體容量並不足以支援參數數量達到一定規模以上的大型語言模型進行模型訓練,已經成為各大科技巨頭不得不正視的問題,像蘋果公司在近期發表的一篇論文中就有提及,由於大型語言模型需要人工智慧加速器和高 DRAM 儲存容量,該公司的研究人員正在開發一種使用快閃記憶體晶片來儲存 AI 模型資料的技術,旨在將大型語言模型引入記憶體容量有限的裝置,像是iPhone 和 Mac系列等產品。 然而,作為領先的儲存解決方案供應商和技術先驅,群聯電子發展的更早,2023年中,便已經推出了自主研發的aiDAPTIV+技術,透過整合SSD的AI運算架構,將大型AI模型做結構性拆分,有效的降低AI服務所需投入的硬體擴建成本。其核心概念即是利用成本效益高、大容量和可擴展性的固態硬碟來參與訓練生成式AI和大型語言模型,分擔顯示卡記憶體需暫存訓練資料和模型計算過程中產生的數據等負擔,藉此克服本地端因顯示卡記憶體容量有限而無法使用更大參數量的模型來進行模型訓練的困境。

.

aiDAPTIV+ , 突破性的解決方案

aiDAPTIV+技術將固態硬碟整合到AI模型訓練框架內,在訓練的過程中,訓練模型和計算過程中產生的數據都儲存在固態硬碟內,每次只將需要處理的部分模型暫時放入顯示卡記憶體進行計算,待計算結束後再將結果存回固態硬碟中。這種方式有效地減少了對顯示卡記憶體的依賴,避免了模型和數據“塞滿”記憶體的情況發生。

根據群聯電子實際測試的結果顯示,在顯示卡記憶體能夠被釋放之後,將能夠處理比原先更多批次的待訓練資料,進而使落地訓練的整體效率能夠大幅提升。

一旦採用了aiDAPTIV+的解決方案,顯示卡及其高速記憶體的容量需求將不再是模型訓練發展的瓶頸,也將能夠化解建置大量伺服器的必要性和其所帶來的高額成本,將原本需要超過千萬的硬體擴充成本,降低為數萬元的水準,近似於一般用戶對於個人電腦或3C產品的花費水準,這將使得每個商業用戶或家庭使用者都可以使用有限的資源來進行更大型並有效率的模型訓練。 Home computing,一個具有前景和發展潛力的運算概念,隨著aiDAPTIV+打破Home computing發展的枷鎖與束縛 — 高昂的硬體設備成本,過去因經費有限的商業用戶和家庭使用者將能夠享有本地AI運算所帶來高安全性和隱私保護,甚至是高度客製化的使用體驗。群聯電子的aiDAPTIV+ 目前已經與全球多家合作夥伴攜手,目標共同推進AI發展的下個新世代 – 掀起 Home Computing的浪潮!

.

.

.

支援的模型

-

-

- Llama 2 7,13,70B

- Llama 33B

- Vicuna 33B

- Falcon 180B

- CodeLlama 7B, 34B, 70B

- Whisper V2, V3

- Metaformer m48

- Clip large

- Resnet 50, 101

- Deit base

- Mistral 7B

- TAIDE 7B

-

常見問題 (FAQ):

沒有專門的 AI 工程團隊我可以使用 aiDAPTIV+ 嗎?

是的。 愛達普替夫+ 的設計充分考慮了易用性,支援即插即用部署。本系統僅需具備一般 IT 知識即可 操作這對於缺乏專業人工智慧員工的組織來說是一個理想的選擇。

aiDAPTIV+ 如何在有限的 GPU 記憶體上處理大型資料集?

愛達普替夫+ 使用其 快取 SSD 將資料分割成 GPU 可管理的切片。這些切片按順序處理,並使用高速閃存重新編譯,從而能夠訓練大型模型(例如 Llama 13B 和 70B),而不會因記憶體溢出而導致崩潰。

典型的 aiDAPTIV+ 設定包含什麼?

標準部署包括:2-4 個工作站級 NVIDIA GPU、Intel W5-3435X CPU、512GB DDR5 RAM 和兩個 群聯 快取 2TB SSD。 愛達普替夫 軟體層管理 計算 和存儲。

與全雲設定相比,訓練表現如何?

愛達普替夫+ 在支援的模型上實現了線性擴展並縮短了 epoch 時間。雖然大型雲端叢集提供了強大的運算能力, 愛達普替夫+ 在受控、安全的環境中提供一致且有效率的訓練週期。

aiDAPTIV+ 是否適合微調專有或敏感資料?

當然。由於培訓是在現場進行的,組織 保持 完全控制資料儲存和處理—消除 公有雲平台固有的暴露風險,並更好地遵守產業特定的資料治理標準。