同社は、画期的なaiDAPTIV+製品におけるいくつかの重要な進歩を披露した。

NVIDIA GTCカンファレンスの目的は AI Phison は、aiDAPTIV+ 製品とソリューションのエキサイティングな新開発を発表するために参加しました。39,000 人以上が現地に集まり、さらに 300,000 人がオンラインでショーを体験したこのイベントは、AI 業界と Phison の両方にとって大成功でした。まさに AI のスーパーボウルでした。

GTC での Phison の展示のハイライトをお読みください。

業界初、LLMOps対応AIノートPC登場

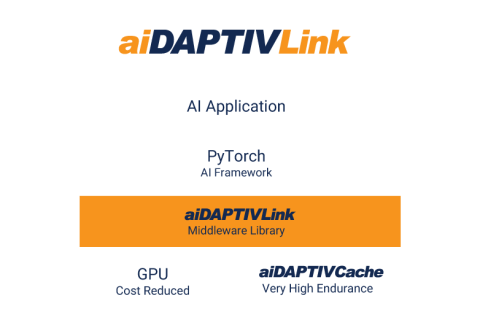

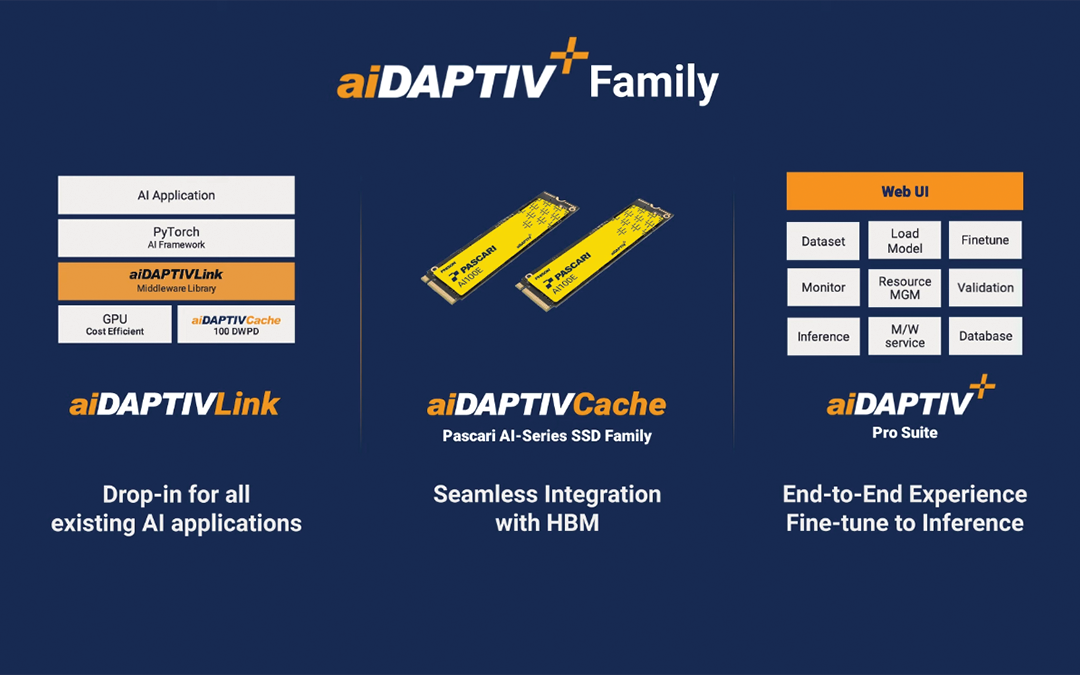

提携先 メインギア、Phison はカンファレンス参加者に、最大 80 億のパラメータを持つモデルをサポートする初の LLM トレーニング ノート PC コンセプト デモを披露しました。MAINGEAR AI ノート PC には、Phison aiDAPTIVCache SSD、aiDAPTIVLink ミドルウェア、aiDAPTIV+ Pro Suite GUI ベースのオールインワン機能セットが含まれており、取り込み、微調整、検索拡張生成 (RAG)、監視、検証、推論などの LLM 操作が可能です。

このラップトップは、AI 開発者やデータ サイエンティストを目指す人、またクラウドや数百万ドル規模のオンプレミス インフラストラクチャに依存せずに独自のデータで AI モデルをトレーニングしたい組織に最適です。

「aiDAPTIV+は、自分のデータの専門家を常にバックパックの中に持っているのと同じようなものです」と、ファイソンUSのGM兼社長であるマイケル・ウー氏は、同社の最近の発表会で述べた。 プレスリリース「独自に微調整した、または RAG 対応の LLM でトレーニングや推論を行えるだけでなく、洞察の恩恵も得られます。」

同じプレスリリースで、MAINGEARのCEOであるウォレス・サントスは、この概念実証ラップトップは「強力なエッジAI推論とデバイス上のモデルトレーニングをどこからでも可能にし、企業、教育者、学生に AIモデルを開発するための費用対効果の高いツール 従来のデータセンター インフラストラクチャの複雑さはありません。」

レビュアー、サヤン・セン、レポート ネオウィンは、Phison-MAINGEAR AIラップトップは「利用可能なHBM(高帯域幅メモリ)/ GDDRを拡張し、NANDフラッシュベースのaiDAPTIVCacheと組み合わせることで動的キャッシュに役立ちます」と述べています。 記事 aiDAPTIV+ を搭載した MAINGEAR AI PC が、aiDAPTIV+ を搭載していない MAINGEAR セットアップよりもはるかに優れていることを示すグラフが含まれています。

aiDAPTIV+テクノロジーを搭載したMAINGEAR AI PCは、2025年第2四半期に3つの構成済みモデルで発売される予定です。お客様は、 オンラインで登録する 在庫状況と注文に関する詳細情報を入手します。

aiDAPTIV+でエッジでのAI推論を可能にする

ファイソンは、 aiDAPTIV+テクノロジー NVIDIA Jetson ベースのデバイスで実行できることが検証されました。aiDAPTIVCache SSD を使用すると、推論と Low-Rank Adaptation (LoRA) ベースの LLM トレーニング機能が強化されます。これにより、エッジ コンピューティングとロボット工学のユース ケースで AI の可能性がまったく新しい世界へと広がります。また、自動運転車、産業オートメーション、ヘルスケア診断、小売顧客分析、通信、農業、環境モニタリング、インテリジェント監視などにも役立ちます。

アップデートされたaiDAPTIVLinkミドルウェアにより、より高速でより複雑なプロンプトが可能に

Phison は aiDAPTIVLink ミドルウェアを更新し、今年 4 月に提供開始することを決定しました。aiDAPTIVLink 3.0 は、リコール応答の高速化とプロンプトへの回答精度の向上により、推論機能を強化します。これは、トークンの長さを長くすることで実現され、より複雑なプロンプトが可能になります。

アン GuruFocusによる記事 このパフォーマンスの向上を図解しました。

「エッジデバイスでの生成AIの採用は、大規模言語モデル(LLM)を実行する際のDRAM容量の制約によって制限されることがよくあります。NVIDIA Jetson AGX Orinを搭載した[Adlink] DLAP Supremeシリーズは、Phison aiDAPTIV+テクノロジーでAIパワーを高め、トークン長の制限を効果的に克服し、推論速度を向上させます。たとえば、NVIDIA Jetson AGX Orin 64GB構成を搭載したDLAP-411 Orin SupremeをLlama3.1-70Bモデルと併用すると、推論[最初のトークンまでの時間] TTFTが52倍改善され、トークン長が4倍になります。」

他のメディアのコメントを見る

ファイソンの発表はGTCの要約記事に掲載されました。 フォーブス:

「Phison 社は、オンプレミス インフラストラクチャ向けのより手頃な AI トレーニングおよび推論ソリューションである aiDAPTIV+ の拡張機能を発表しました。aiDAPTIV+ は、AI ノート PC だけでなく、Nvidia Jetson プラットフォームを実行するエッジ コンピューティング デバイスにも統合されています。」

トゥイークタウンMAINGEAR-Phison AI PC ラップトップの場合:

「ファイソンは、現在高価なGPUメモリで行われている処理を低コストのNANDフラッシュストレージにオフロードすることで、AIモデルの実行コストを削減することを目指しています。これにより、AIモデルの運用コストが縮小し、より安価なデバイスで大規模なモデルをトレーニングできるようになります。同社のaiDAPTIV+ソフトウェアのパワーを活用することで、ユーザーはバックパックに収まるデバイス内で、独自のデータを使用してAIモデルをカスタマイズできるようになります。」

トゥイークタウンaiDAPTIV+ ソリューションが AI トレーニングのコストを大幅に削減する仕組みについて:

「ファイソン社は、世界初の1兆パラメータモデルが2025年末までに発表されると予想しています。…ファイソン社は、1兆パラメータモデルの運用コストはGPUの生の電力でおよそ$3百万になると予想していますが、同社はコストをわずか$10万にまで軽減する計画を概説しています。どのように?SSD、ファイソン社のaiDAPTIV+ソフトウェア、およびNVIDIA GH200スーパーチップの組み合わせです。」

Phison の直感的な aiDAPTIV+ ソフトウェアを使用して GPU から SSD に処理をオフロードすることで、同社は大規模な AI モデルを正常に実行するために必要な GPU の数を大幅に削減できます。Phison は、最大規模のモデルのトレーニング コストを価格の 30 分の 1、つまり現在推定されている運用コストの 4% 未満に削減できると予想しています。

ブロックとファイル、aiDAPTIV+の機能について:

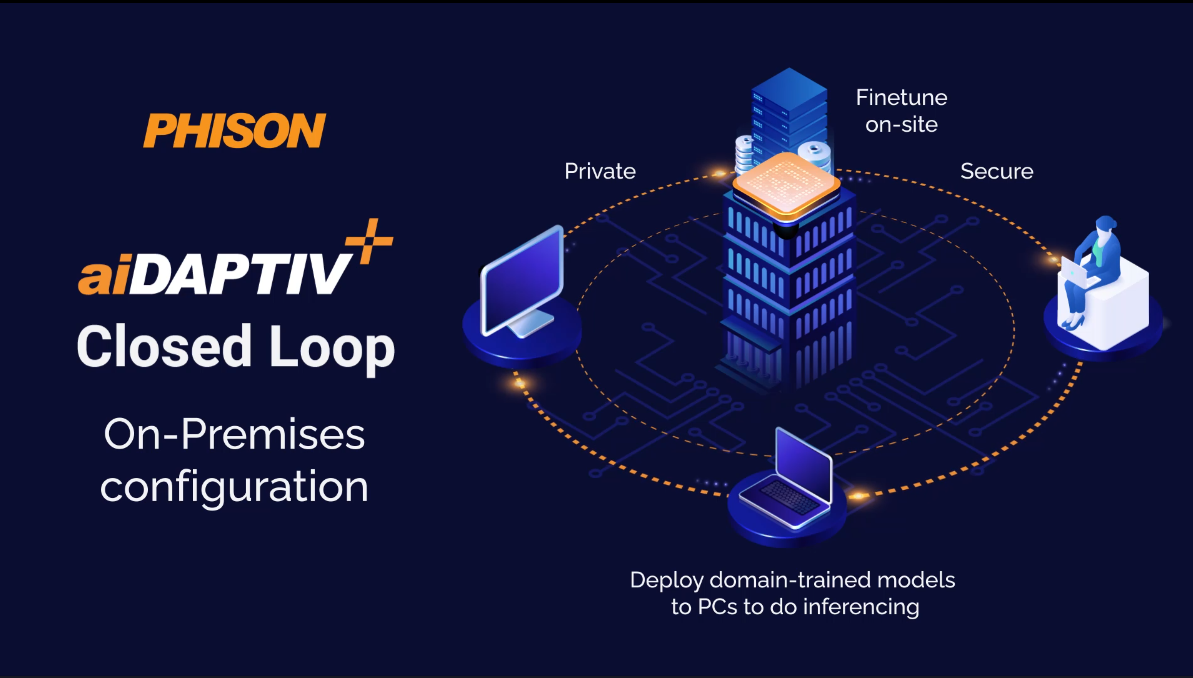

「aiDAPTIV+は、手頃な価格のGPUメモリ拡張機能です。オンプレミスの「クローズドループ」型のセキュアネットワーク内で、ユーザーがLLMを自社データでトレーニングできるだけでなく、シンプルなユーザーインターフェースでデータ操作や質問も行えます。aiDAPTIV+を搭載したIoT向けAI推論は、Phison社によるNvidia Jetsonベースデバイスの検証により、エッジコンピューティングやロボティクスのユースケースをサポートするようになりました。」

aiDAPTIV+テクノロジーの詳細については、こちらをご覧ください 説明ビデオ >>

Phison からの追加 AI コンテンツ